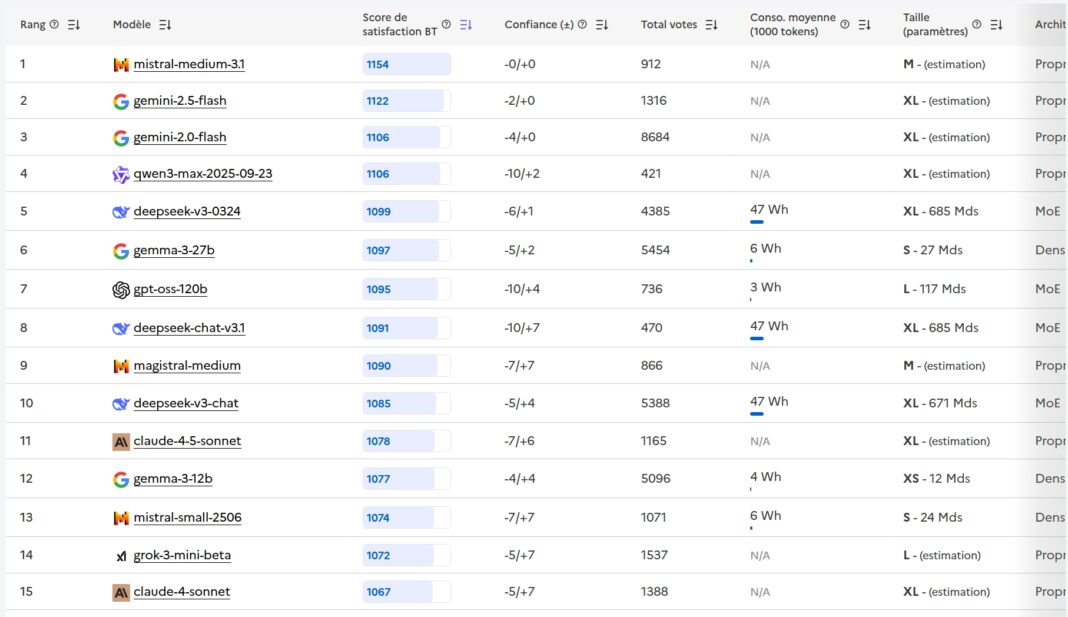

Publié le • Source : Comparia (données du 04/11/2025)

Le nouveau classement Comparia, fondé sur le score Bradley–Terry, met en avant l’ascension de Mistral AI et confirme le rôle central des architectures Mixture of Experts. Voici le Top 5 et les tendances à retenir pour 2025.

🚀 Classement IA 2025 : Mistral détrône les géants

🌍 Mistral AI propulse l’Europe en tête grâce à un modèle dense performant, marquant un tournant dans la souveraineté numérique et technologique.

🧠 Le succès de mistral-medium-3.1 montre qu’un modèle dense optimisé peut surpasser les architectures Mixture of Experts (MoE) en cohérence et stabilité.

🤖 Le classement Comparia repose sur des évaluations humaines, valorisant la clarté, la logique et la pertinence des modèles, au-delà des seuls benchmarks classiques.

🛠️ DeepSeek se distingue par des poids ouverts, facilitant l’hébergement local, la personnalisation privée et l’indépendance des infrastructures IA.

⚖️ Le classement 2025 reflète un nouvel équilibre mondial entre États-Unis, Chine et Europe, où l’IA souveraine devient un enjeu stratégique majeur.

Top 5 des modèles d’IA générative (Comparia – 04/11/2025)

| Rang | Modèle | Score Bradley–Terry | Organisation | Licence | Architecture | Release |

|---|---|---|---|---|---|---|

| 1 | mistral-medium-3.1 | 1154 | Mistral AI | API-only | Dense | 08/2025 |

| 2 | gemini-2.5-flash | 1122 | API-only | MoE | 06/2025 | |

| 3 | gemini-2.0-flash | 1106 | API-only | MoE | 12/2024 | |

| 4 | qwen3-max-2025-09-23 | 1106 | Alibaba | API-only | MoE | 09/2025 |

| 5 | deepseek-v3-0324 | 1099 | DeepSeek | Open Weights | MoE (685B) | 03/2025 |

Note : Les positions et scores ci-dessus proviennent des données publiques de Comparia au 04/11/2025.

Méthodologie : le score Bradley–Terry en bref

Le classement repose sur une agrégation de comparaisons par paires. Des évaluateurs comparent des réponses de modèles sur des tâches variées (rédaction, synthèse, explication, raisonnement). Le modèle Bradley–Terry convertit ces préférences en score relatif. Cette approche met l’accent sur la qualité perçue, en complément des benchmarks automatiques.

- Comparaisons humaines : jugement de clarté, cohérence, pertinence et factualité.

- Score relatif : plus un modèle est préféré, plus son score augmente.

- Interprétation : il s’agit d’un indicateur de performance perçue, utile pour orienter les usages éditoriaux et professionnels.

Pourquoi Mistral AI prend la tête

Le modèle mistral-medium-3.1 s’illustre par l’équilibre entre précision, stabilité et aisance multilingue. Trois facteurs se détachent :

1) Architecture dense optimisée

Une architecture dense active l’ensemble des paramètres à chaque requête. Elle favorise la continuité argumentative, limite les ruptures de style et offre une qualité stable sur les réponses longues.

2) Raisonnement structuré

Les évaluations humaines valorisent la capacité à problématiser, enchaîner des idées et conclure sans digressions ni contradictions, un point clé pour les usages éditoriaux, techniques et analytiques.

3) Excellence multilingue

L’aisance du modèle en français, espagnol et italien soutient les déploiements européens et internationaux, en rédaction comme en support client.

Google Gemini : la puissance du Mixture of Experts

Gemini 2.5 Flash et Gemini 2.0 Flash confirment une approche MoE efficace pour concilier performance et coût. En activant un sous-ensemble d’experts selon la requête, ces modèles optimisent l’inférence tout en préservant la qualité sur la conversation, la recherche d’information et le support.

- Bon ratio qualité/coût d’exécution.

- Réactivité et latence contenue à fort trafic.

- Variabilité qualitative possible selon l’expert sollicité.

Accès : modèles proposés en API-only, adaptés aux intégrations cloud et aux cas d’usage à grande échelle.

Qwen (Alibaba) : progression soutenue

Qwen3 Max atteint le même score BT que Gemini 2.0 Flash dans ce Top 5. L’écosystème Qwen affiche une forte dynamique sur le multilingue, l’e-commerce et l’assistance professionnelle, avec une optimisation marquée pour les workflows cloud.

Accès : priorité à l’infrastructure Alibaba Cloud, diffusion mondiale en progression selon les régions.

DeepSeek V3 : l’atout des poids ouverts

DeepSeek V3 se distingue par la disponibilité de poids ouverts, un avantage décisif pour l’auto-hébergement, la personnalisation sur données privées et l’optimisation fine des coûts. C’est un choix naturel pour les équipes R&D, les intégrateurs et les organisations sensibles à la souveraineté technologique.

- Personnalisation avancée (données et guides de style internes).

- Déploiement sur infrastructure propriétaire ou hybride.

- Maîtrise accrue de la confidentialité et des budgets.

Tendances 2025 à surveiller

1) Souveraineté et multilingue

La première place de Mistral AI illustre l’émergence d’un pôle européen compétitif, avec un focus sur la qualité en langues latines et l’intégration dans les environnements réglementés.

2) Généralisation du MoE

Le Mixture of Experts s’impose pour équilibrer qualité et coût sur des volumes d’usage élevés, notamment en service client, génération marketing et productivité bureautique.

3) Ouverture des poids

L’ouverture des poids devient un critère de sélection structurant. Elle facilite la conformité, l’auditabilité et la customisation, tout en offrant des trajectoires de TCO compétitives.

Découvrir le classement des meilleurs IA sur le site comparia :

https://comparia.beta.gouv.fr/ranking

FAQ

- Quel est le meilleur modèle d’IA générative en 2025 ?

- Selon le classement Comparia du 04/11/2025, mistral-medium-3.1 occupe la première place.

Qu’est-ce que le score Bradley–Terry ?

Un modèle statistique de comparaison par paires : des jugements humains sont agrégés pour produire un score de performance relative entre systèmes.

- Quelle différence entre modèle dense et MoE ?

- Un modèle dense active l’ensemble de ses paramètres à chaque requête. Un modèle MoE active un sous-ensemble d’experts spécialisés, pour optimiser coûts et latence.

Pourquoi l’ouverture des poids est-elle déterminante pour les entreprises ?

Elle permet l’auto-hébergement, la personnalisation sur corpus privé, l’auditabilité et la maîtrise du TCO, avec un contrôle renforcé sur la confidentialité.

Pôle d’Expertise de la Régulation Numérique

Le PEReN (Pôle d’Expertise de la Régulation Numérique) est un service public national chargé d’accompagner les pouvoirs publics dans la régulation des plateformes numériques et de l’intelligence artificielle. Il mobilise une expertise technique avancée pour analyser les algorithmes, traiter les données et développer des outils innovants. Ses travaux, réalisés dans une logique de souveraineté et de mutualisation, sont partagés en open source afin de favoriser une régulation transparente, collaborative et au service de l’intérêt général

- Acquisition digitale : quand seo, ia et contenus s’unissent pour transformer le web en machine à leads - avril 21, 2026

- Protection remorque 2026 : cette solution personnalisée séduit par sa résistance aux UV, sa durabilité et son ajustement précis - avril 8, 2026

- Assurance VSP 2026 : quelles garanties privilégier pour vraiment rouler protégé ? - mars 31, 2026